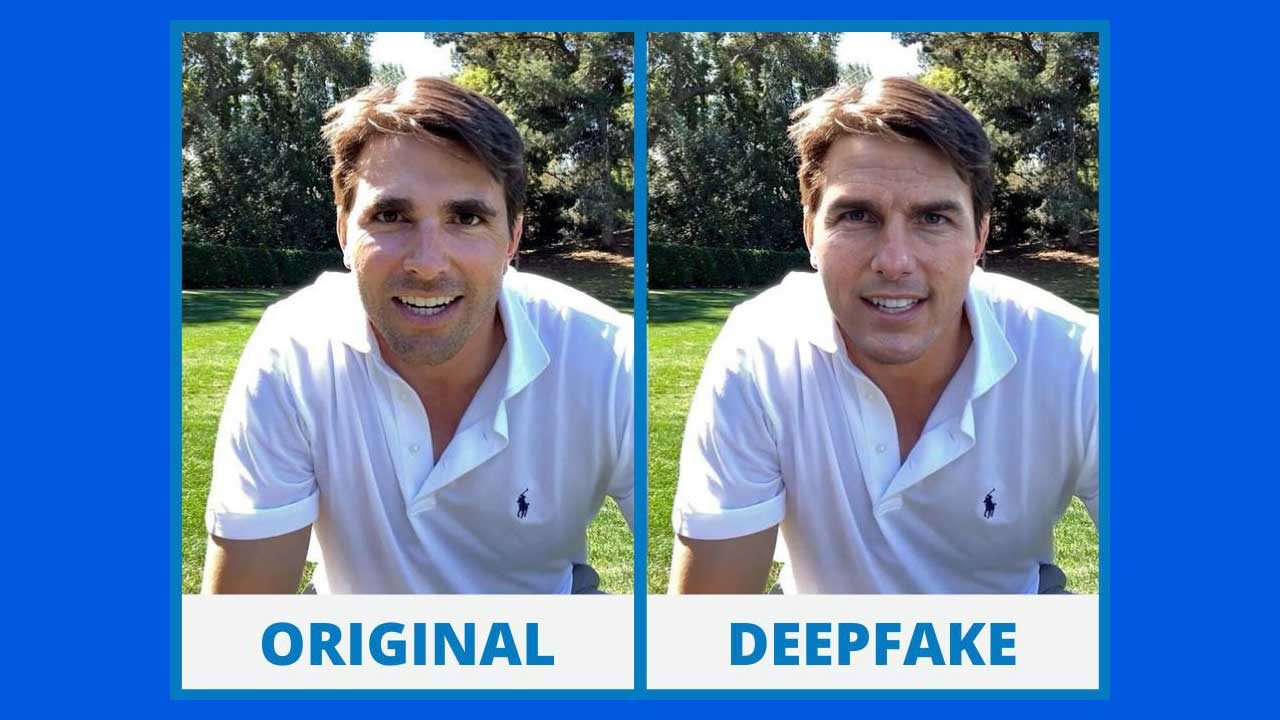

Trend Micro’nun son araştırması, deepfake teknolojisini kullanan siber suçlularının kullandığı yöntemleri ortaya koyuyor. Dünyanın önde gelen siber güvenlik şirketlerinden Trend Micro, deepfake teknolojisiyle gerçekleştirilen siber suçların ulaştığı boyutları ve yaygınlık düzeyini ortaya koyan yeni bir rapor yayınladı. Üretken yapay zeka araçlarının daha güçlü, ulaşılabilir ve uygun maliyetli hale gelmesiyle birlikte, siber suçlular bu teknolojileri hızla benimseyerek iş dünyasını hedef alan dolandırıcılıktan şantaja ve kimlik hırsızlığına kadar geniş bir yelpazede saldırılar düzenliyor.

Yeni Nesil Yapay Zeka Suç Araçlarına Kapsamlı Bir Bakış: “Taklit Et, Gerçek Gibi Göster!” (Deepfake it ’til You Make It: A Comprehensive View of the New AI Criminal Toolset) başlıklı raporun tamamı için:https://www.trendmicro.com/vinfo/us/security/news/cybercrime-and-digital-threats/deepfake-it-til-you-make-it-a-comprehensive-view-of-the-new-ai-criminal-toolset

Araştırma, deepfake teknolojisinin artık sadece bir heyecan dalgası olmaktan çıkıp gerçek dünyada kötüye kullanılan bir araca dönüştüğünü ortaya koyuyor. Dijital güveni zedeleyen bu teknoloji, şirketleri yeni risklerle karşı karşıya bırakıyor ve siber suçluların iş modellerini hızla büyütmelerine olanak tanıyor.

Trend Micro Kıdemli Tehdit Araştırmacısı David Sancho, “Yapay zeka ile üretilen medya yalnızca gelecekteki bir tehdit değil, günümüzde doğrudan iş dünyasını hedef alan somut bir risk. Üst düzey yöneticilerin taklit edilmesinden işe alım süreçlerinin manipüle edilmesine, finansal güvenlik adımlarının kolaylıkla atlatılmasına kadar ciddi örnekler görüyoruz. Bu araştırma bir uyarı niteliğinde. Şirketler deepfake çağını ciddiye alıp hazırlık yapmıyorsa, zaten gerideler. Artık ‘görmek’ inanmaya yetmiyorsa, dijital güveni en baştan inşa etmemiz gerekiyor” dedi.

Araştırma, siber saldırganların artık ikna edici saldırılar gerçekleştirmek için yeraltı uzmanlığına ihtiyaç duymadığını ortaya koyuyor. Bunun yerine, içerik üreticilerine yönelik olarak pazarlanan hazır video, ses ve görsel üretim platformlarını kullanarak son derece gerçekçi deepfake içerikler oluşturuyorlar. Hem bireyleri hem de kurumları kandırabilen bu sahte içerikler, düşük maliyetli, kullanımı kolay ve kimlik doğrulama sistemleri ile güvenlik önlemlerini aşma konusunda her geçen gün daha yetenekli hale geliyor.

Araştırma, bu platformların kullanıldığı ve giderek büyüyen bir siber suç ekosistemini gözler önüne seriyor. Deepfake teknolojileriyle gerçekleştirilen ikna edici dolandırıcılık senaryoları arasında şunlar öne çıkıyor:

- CEO Dolandırıcılığı: Saldırganlar, üst düzey yöneticilerin sesini veya görüntüsünü deepfake teknolojisiyle taklit ederek gerçek zamanlı toplantılarda yöneticileri taklit ediyor ve tespiti giderek zorlaşan dolandırıcılıklar gerçekleştiriyor.

- Sahte Adaylarla İşe Alım Süreci: Yapay zekâyla desteklenen sahte adaylar, mülakatları geçerek kurum içi sistemlere yetkisiz erişim sağlamak üzere işe alım süreçlerini manipüle ediyor.

- Finansal Hizmetlerde KYC Atlama Girişimleri: Kimlik doğrulama (KYC) kontrollerini aşmak için deepfake kullanan girişimlerde artış yaşanıyor. Sahte belgelerle anonim şekilde kara para aklamak mümkün hale geliyor.

Siber suç dünyasında, bu tür operasyonları kolaylaştırmak amacıyla eğitimler, araç setleri ve hizmetler aktif şekilde ticarete konu oluyor. İşe alım süreçlerini atlatmak için adım adım hazırlanan rehberlerden, yüz değiştirme yazılımlarına kadar birçok “kullanıma hazır” araçla bu tür saldırıları gerçekleştirmek artık son derece kolay hale gelmiş durumda.

Deepfake destekli dolandırıcılıkların hem sayısı hem de karmaşıklığı artarken, işletmelere riskleri en aza indirmek ve çalışanlarını ile iş süreçlerini korumak için proaktif önlemler almaları çağrısında bulunuluyor. Bu önlemler arasında; çalışanların sosyal mühendislik riskleri konusunda eğitilmesi, kimlik doğrulama süreçlerinin gözden geçirilmesi ve yapay içerik (sentetik medya) tespiti için teknolojik çözümlerin değerlendirilmesi yer alıyor.